Från maskin till människa

”Om 200 meter, sväng vänster.” Många är vana att navigera efter en talande gps, och datorerna blir allt bättre på att tala naturligt. Men hur går det till?

Talsyntes, även kallat text to speech, TTS, innebär att med hjälp av en maskin försöka efterlikna en mänsklig röst. Detta används överallt där man vill kunna lyssna i stället för att läsa: i allt från program för språkinlärning och röststyrning till röstproteser och läshjälp för synskadade. Och det tar allt större plats i vår vardag.

Förra året gick landets taltidningar över från mänskligt inläst tal till talsyntes. Datorrösten ”Erik” är skapad av talsyntesföretaget Acapela i Solna. Tekniken som används kallas unit selection, och bygger på att ett urval inspelade språkljud från en mänsklig röst klipps ihop på olika sätt. Datalingvisten Charlotta Jagt berättar hur det fungerar.

– Vi spelar in en professionell talare, med ett manus vars innehåll gör det möjligt att spela upp vad som helst i det svenska språket utan att behöva spela in varje ord för sig.

Manuset är noga designat utifrån olika texter. Dessa kan komma från dagstidningar, webbsidor och Twitter, vara sportresultat, recept och så vidare. Talaren läser in ett urval av 8 000–10 000 meningar, utan inbördes sammanhang. För att skapa en svensk röst krävs ungefär 40 timmars inspelningstid.

– Vi vill spela in så få meningar som möjligt, men ändå få så stor täckning som möjligt av språket. Vi utgår från ett jättestort uttalslexikon, och kan skapa regler även för ord som inte finns inspelade. Blir det fel kan vi lägga till nya regler efter hand.

Olika språkljud och stavelser markeras i den inspelade ljudfilen. Till den hör också en textfil som beskriver hur innehållet ska uttalas – en fonetisk transkription.

När man sedan vill få en text uppläst av talsyntesen måste även den okända texten analyseras – enligt samma språkregler – och matchas med den fonetiska transkriptionen. Datorn trålar helt enkelt igenom databasen, och plockar de inspelade ljudenheter som den tycker verkar lämpligast för att ”bygga” det nya talet, med så korrekt betoning som möjligt. Ibland hela ord och meningar, men oftast är ett ord uppbyggt av flera mindre ljudbitar.

När Charlotta Jagt skriver in ”Språktidningen” i Acapelas talsyntes, ser vi ”under huven”, att namnet är hopklippt av hela sex ord: SPritkök, sPRÅKlig, luKTar, helTID, inbjuDNing, begravNINGEN. Fonemen – språkljuden – klipps alltid mitt i för att klippen ska märkas så lite som möjligt. Första ljudet, SP, klipps alltså mitt i P, medan PRÅK klipps mitt i P och mitt i K …

Unit selection är den vanligaste typen av talsyntes i dag; den fungerar oftast perfekt vid uppläsning av trafikmeddelanden och liknande. Men metoden har sina begränsningar när det gäller mer avancerade texter, enligt Joakim Gustafson, professor i talteknologi vid Kungliga tekniska högskolan, KTH, i Stockholm.

– Unit selection kan låta superbra fram till de ställen där språkljuden klipps ihop. Där kan det låta jättedåligt, och det upplevs som irriterande. Det har visat sig att folk ofta hellre vill ha halvbra ljud hela tiden, än bra ibland och dåligt ibland.

Ett annat problem är att betoningen lätt blir fel när man klipper ihop orden. I meningen Jag ser en bil, kan ju orden betonas på olika sätt, och därmed få olika innebörd: JAG ser en bil (till skillnad från dig), Jag SER en bil (jag hör den inte), Jag ser EN bil (inte två) eller Jag ser en BIL (inte en mc). Och vissa ord är homografer, det vill säga ord som skrivs likadant, men uttalas olika: Ser du tomten på tomten? Vem har format detta format? Det är en banan på banan.

Dessutom kan rösterna låta för glada eller för ledsna för sammanhanget. Och ord låter för det mesta olika beroende på var de finns i en mening: i början, i mitten eller i slutet. Ofta går tonhöjden ner i slutet. När vi testade ordet ”Språktidningen” hämtades ordet ”begravNINGEN” i slutet av en mening, där tonhöjden gick ner.

– En felaktig betoning saboterar helhetsupplevelsen. Det skär sig, konstaterar Joakim Gustafson.

När den amerikanske filmkritikern Roger Ebert förlorade rösten i början av 2000-talet, i samband med en canceroperation, fick han en röstprotes med talsyntes skapad genom unit selection. Talsyntesen kunde dessutom göras utifrån hans egen röst från inspelade kommentarer till dvd-utgåvor av klassiska filmer, som Casablanca och Citizen Kane.

– Men det lät inte som om rösten menade vad Roger Ebert menade, berättar Joakim Gustafson. Roger Ebert gick tillbaka till att skriva på lappar, för även om systemet var byggt av hans egen röst, så var det inte han. Han ville ju kunna styra hur han sa saker.

Roger Ebert föreslog då ett ”Ebert-test” av talsyntesen: om den kunde dra ett skämt med rätt timing – då skulle han vara nöjd. Men dit är det fortfarande långt.

– I en dialog förmedlar vi ju så mycket mer med rösten än bara orden, säger Joakim Gustafson. Vi vill kunna dra på orden, låta osäkra, signalera att vi ändrar oss, med mera. Vi vill få en talsyntes som vi kan styra dynamiskt, som utvecklas vartefter.

Dessutom tror han att behovet av bra talsyntes kommer att öka – inte minst i takt med att vi delar miljö med så kallade sociala robotar, till exempel inom industrin och sjukvården.

Det senaste inom talsyntes är att träna datorn på hur en mänsklig röst låter utifrån kortare inspelningar, och därefter kasta bort de inspelade ljuden. Kvar finns då en helt datoriserad röst som kan styras med olika parametrar, till exempel för att göra den ljusare eller mörkare.

Med denna teknik, kallad HMM, hidden Markov model, har Acapela skapat en röstprotes åt den amerikanske ALS-patienten Eric Von Schaumburg, 32 år. Hans egen röst hade redan blivit för dålig för att man skulle kunna spela in den som grund till syntesen, men brodern hoppade in i hans ställe och läste in manustexten. Och Acapela la på en djupare klang för att rösten skulle låta mer som Erics.

Men fortfarande är det svårt att få talsyntesen att låta som en riktig människa.

– I naturligt tal gör vi mycket för att spara röstansträngningen. När du ska säga en bil, så låter det egentligen som ”embil”, eftersom det är lättare att säga. Och vi ger ofta återkoppling för att visa att vi lyssnar, med småord som ah, mm, hm, okej, ja, oj, aha. Men de kan betyda lite olika saker. Ett okej kan ju till exempel vara tvekande eller ironiskt, säger Joakim Gustafson.

För att få det syntetiska talet att låta naturligare, bygger han och hans kolleger upp en databas med dialoger, och gör markeringar i ljudfilerna: ”här låter hon osäker”, ”här vill han inte fortsätta prata” och så vidare, för att lära HMM-syntesen hur vi gör när vi talar med varandra.

– Vi kan, bland annat med hjälp av satsmelodin, visa att vi ändrar oss medan vi pratar. Det var en grö… jag menar BLÅgrön bil. Man höjer grundtonen när man betonar det nya ordet – en ökad intensitet. Och om man är osäker så förlänger man ordet. Den typen av saker finns inte alls i talsyntes i dag.

Ett annat problem i dag är att datorn måste ”lyssna färdigt” innan den kan omvandla text till tal. I Joakim Gustafsons forskning ingår även stegvis dialogbearbetning, för att lära datorn hur meningen sannolikt kommer att fortsätta.

– Behöver datorn känna till nästa ord, och nästnästa? Jag vill ju att den ska börja prata innan jag har skrivit färdigt.

hur läraktig hmm-syntesen än är, så vet den ingenting om hur mänsklig talproduktion faktiskt går till. Vill man ha någon som låter glad måste man spela in det. Det svåra är att fånga in alla styrparametrar som behövs för att skapa nyanserna i talet. Det vore bättre om man kunde förstå hur människor gör när de talar, och sedan bygga en modell av rösten.

Just detta arbetar Sten Ternström med i EU-projektet Eunison. Han är professor i musikakustik vid KTH.

– Om jag gör så här, säger han och knäpper med fingret på sin hals, så kommer det ut en ton, men om jag formar munnen annorlunda så blir det ljudet annorlunda: ”Aaaååoouuiii”.

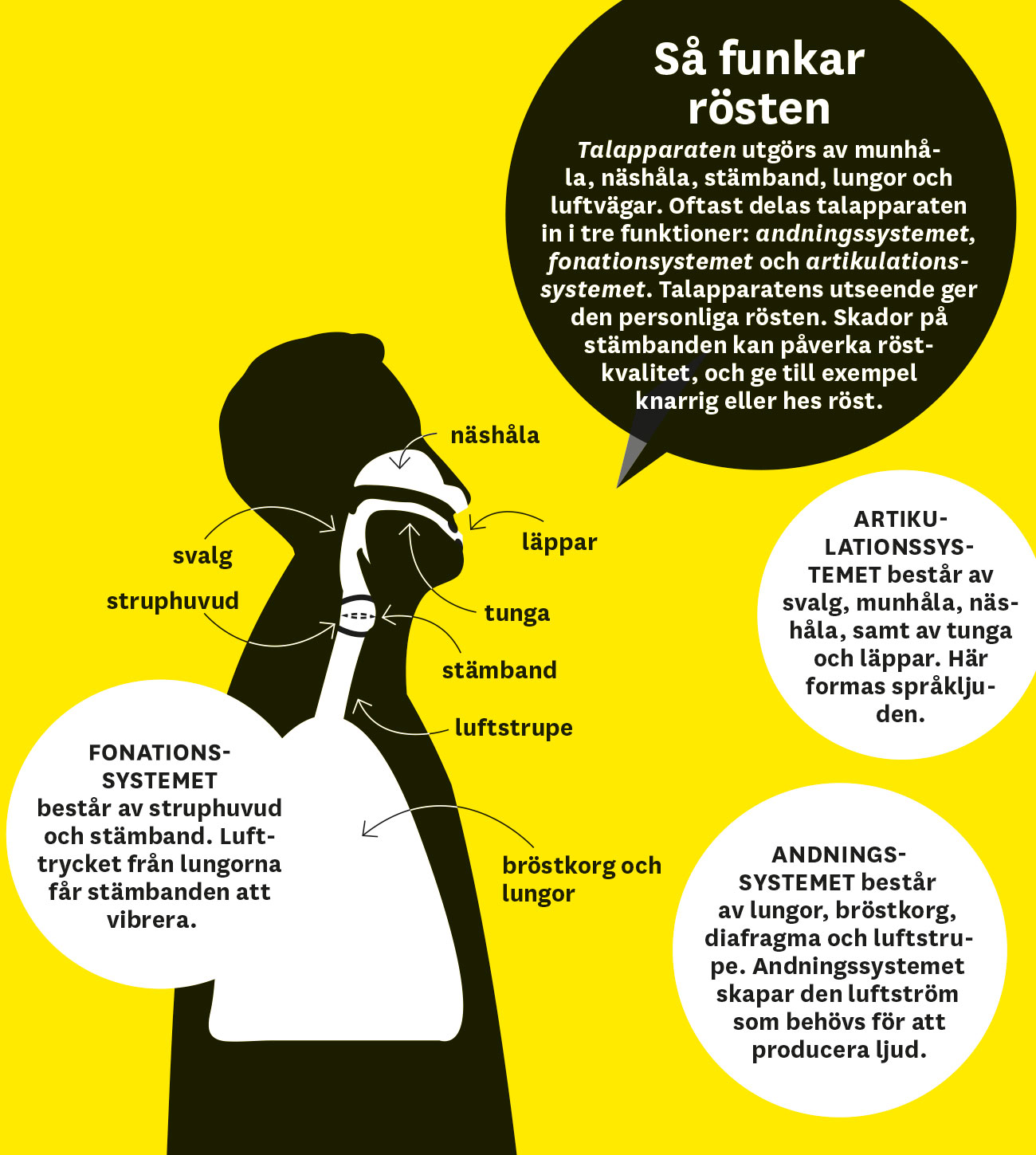

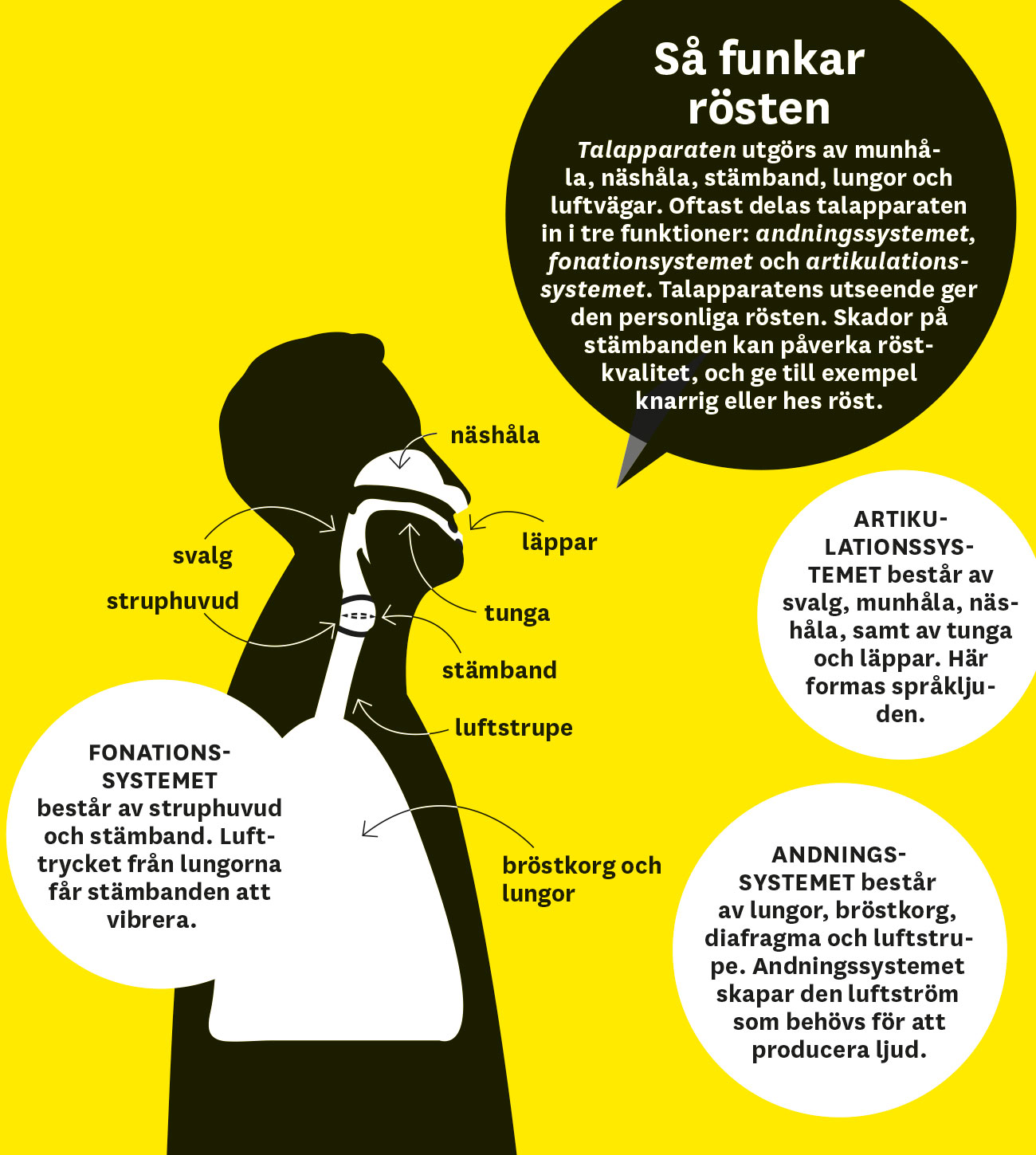

Våra språkljud som lämnar munnen är egentligen tryckvågor i luften. Lungorna står för luften, magens muskler för kraften. Tonen skapas av svängningar i stämbanden. Själva klangen, den personliga rösten, formas av håligheterna på vägen ut genom munnen. Men många detaljer hos mekanismerna bakom röstens alla nyanser är fortfarande oklara, och de har oftast studerats var för sig.

I det omfattande Eunison-projektet, som koordineras vid KTH, bygger talforskare, fysiker och tekniker från hela Europa en 3D-modell av hela talapparaten – med luftstrupe, stämband, gom, käke, tunga och läppar – för att till fullo försöka förstå hur rösten fungerar. Och hur den fallerar.

– Har man en modell av röstens mekanik, så kan man simulera fram precis hur det ser ut härinne, säger Sten Ternström och pekar på strupen. Om jag säger A är tungan långt bak, med stor käköppning och mycket plats i gommen. Om jag säger I är tungan långt fram. Det blir trångt i käköppningen och mer öppet bak.

Genom att dela in kroppens mjuka och hårda delar i små element modelleras fysiken fram i datorn. Bara stämbanden behöver tusentals element, och forskarna beräknar kraft, massa och fjädring med mera på vartenda ett. Det krävs oerhört stor datorkraft. Även en mekanisk modell med stämband i silikon tas fram.

– Vår färdiga modell över människorösten kommer att likna en marionettdocka. Vi kan rycka i en eller flera trådar och se vad som händer, säger Sten Ternström. Hur rör sig en sladdrig slemhinna när man blåser ut ett ljud från magen, till exempel ett F, ”eeefff”? Och hur studsar ljudet i munhålan?

Ett av stegen är att studera hur tungan flyttas för att framställa olika ljud.

– Om du tänker efter vad du gör med tunga och läppar när du talar, så är det en mirakulös följd av mekaniska händelser.

Med en komplett modell av talapparaten, i kombination med HMM-modellen, som lär sig röstens naturliga prosodi – det vill säga talets rytm och melodi – borde det gå att få fram en riktigt bra talsyntes.

Återstår att se om vi någonsin kommer att kunna skratta åt en skämtande talsyntes.

Eva Barkeman är vetenskapsjournalist.

3 x olika talsynteser

Det finns tre typer av talsyntes:

- Parametrisk syntes, där ljudet skapas genom olika styrparametrar. Ett exempel är formantsyntes, där tal skapas genom att ljud filtreras digitalt genom ett antal uttalsregler, från en artificiell röstkälla. Ett annat exempel är HMM-syntes.

- Konkateneringssyntes, där ljudet klipps ihop av tal från inspelade mänskliga röster, till exempel difonsyntes och unit selection. ”Burkat tal” är ett slags pseudosyntes av förinspelade meningar med luckor som fylls i. Används till exempel i talsvarstjänster och stationsuppläsning.

- Artikulatorisk syntes, där man utgår från en modell av det mänskliga talorganet.

Tidslinje

1780 Tal med gummmitratt

Ungraren Wolfgang von Kempelen gjorde världens första ”talande maskin”, där lungorna simulerades med en blåsbälg, stämbanden med ett rörblad av elfenben och munnen med en gummitratt. Genom att i större eller mindre grad täcka över gummitratten med handen, kunde han skapa olika vokaler och vissa konsonanter. (artikulatorisk syntes)

1950 Formantsyntes

Helt datoriserad. En artificiell ljudkälla skapar en grundton eller ett brus, som filtreras för att efterlikna en mänsklig röst genom att man ställer in olika resonansfrekvenser eller formanter. Vokalerna blir bra, konsonanterna sämre. Låter robotartat. Gunnar Fants modell OVE (se faktarutan här intill) är ett exempel på detta. (parametrisk syntes)

1980 Difonsyntes

Består av en liten mängd inspelade nonsensord. Fonemen (språkljuden) klipps ihop till difoner (två halva fonem), för att forma alla ord i språket. Onaturligt, konstigt uttal. (konkateneringssyntes)

1990 Unit selection

Består av en stor mängd inspelat tal, där olika språkljud markeras så att datorn vet var den ska klippa ihop dem. Vanligast i dag. Ju längre sekvenser, desto mer naturligt. (konkateneringssyntes)

2010 HMM-syntes

Helt datoriserad, men bygger på inlärning från inspelat tal. Rösten kan förändras genom signalbehandling. Genom att träna systemet mot 250 korta exempelmeningar kan en begriplig röst skapas. Detta tar cirka två timmar på en modern dator. Låter ganska naturligt, men lite burkigare än unit selection (konkateneringsyntes + parametrisk syntes).

2020? Fysisk simulering

En fullständig modell av ett mänskligt talorgan med strupe, tunga, tänder och läppar och så vidare. Eunison är ett exempel på denna metod. Genom att simulera hur en luftström passerar stämbanden och studsar i hålrummen beräknas det resulterande ljudet. Metoden är komplex, men talet låter naturligt. Kan kombineras med datorinlärda ljud (artikulatorisk syntes).

Läs med öronen!

Över 120 svenska dagstidningar finns som taltidning*. Sedan förra året läses de upp med talsyntes i stället för av riktiga människor. Teknikskiftet innebär mer innehåll och lättare navigation.

Taltidningar har funnits sedan 1980-talet. Till att börja med producerades de med mänsklig inläsning och sändes ut via radionätet. Men bara ett urval av tidningens innehåll lästes in, kanske en femtedel, på grund av den höga produktionskostnaden.

– Det är ur demokratisynpunkt ett viktigt uppdrag att se till att dagstidningar blir tillgängliga även för personer med läsnedsättning, säger Jesper Klein, avdelningschef vid Medier och tjänster på Myndigheten för tillgängliga medier (MTM).

De flesta som tar del av taltidningar är synskadade, men även personer med till exempel dyslexi har nytta av dem.

De taltidningar som i dag produceras med talsyntes innehåller allt som finns i den tryckta tidningen. De taltidningar som MTM ger ut, läses upp av datorrösten ”Erik” med hjälp av unit selection (läs mer om tekniken i artikeln intill). Tidningarna går att lyssna på i app, dator eller i särskilda spelare.

Fördelen med ”syntetiska” taltidningar är att läsaren själv kan bläddra sig fram till de artiklar som hen vill läsa. Nackdelen är att det kan vara jobbigare att lyssna på en syntetisk röst, särskilt när man är ovan.

– Många användare är positiva. De tycker att det är en frihet att kunna läsa var de vill och vad de vill. Andra tycker att det har varit svårt att ta till sig en ny lösning, säger Jesper Klein.

* Taltidningar är vanliga dagstidningar som görs tillgängliga via talsyntes. Det finns även läns-taltidningar som produceras av radiojournalister för synskadade. Dessa ges ut av Sveriges kommuner och landsting och använder inte talsyntes.

Eva Barkeman

Talsyntes, även kallat text to speech, TTS, innebär att med hjälp av en maskin försöka efterlikna en mänsklig röst. Detta används överallt där man vill kunna lyssna i stället för att läsa: i allt från program för språkinlärning och röststyrning till röstproteser och läshjälp för synskadade. Och det tar allt större plats i vår vardag.

Förra året gick landets taltidningar över från mänskligt inläst tal till talsyntes. Datorrösten ”Erik” är skapad av talsyntesföretaget Acapela i Solna. Tekniken som används kallas unit selection, och bygger på att ett urval inspelade språkljud från en mänsklig röst klipps ihop på olika sätt. Datalingvisten Charlotta Jagt berättar hur det fungerar.

– Vi spelar in en professionell talare, med ett manus vars innehåll gör det möjligt att spela upp vad som helst i det svenska språket utan att behöva spela in varje ord för sig.

Manuset är noga designat utifrån olika texter. Dessa kan komma från dagstidningar, webbsidor och Twitter, vara sportresultat, recept och så vidare. Talaren läser in ett urval av 8 000–10 000 meningar, utan inbördes sammanhang. För att skapa en svensk röst krävs ungefär 40 timmars inspelningstid.

– Vi vill spela in så få meningar som möjligt, men ändå få så stor täckning som möjligt av språket. Vi utgår från ett jättestort uttalslexikon, och kan skapa regler även för ord som inte finns inspelade. Blir det fel kan vi lägga till nya regler efter hand.

Olika språkljud och stavelser markeras i den inspelade ljudfilen. Till den hör också en textfil som beskriver hur innehållet ska uttalas – en fonetisk transkription.

När man sedan vill få en text uppläst av talsyntesen måste även den okända texten analyseras – enligt samma språkregler – och matchas med den fonetiska transkriptionen. Datorn trålar helt enkelt igenom databasen, och plockar de inspelade ljudenheter som den tycker verkar lämpligast för att ”bygga” det nya talet, med så korrekt betoning som möjligt. Ibland hela ord och meningar, men oftast är ett ord uppbyggt av flera mindre ljudbitar.

När Charlotta Jagt skriver in ”Språktidningen” i Acapelas talsyntes, ser vi ”under huven”, att namnet är hopklippt av hela sex ord: SPritkök, sPRÅKlig, luKTar, helTID, inbjuDNing, begravNINGEN. Fonemen – språkljuden – klipps alltid mitt i för att klippen ska märkas så lite som möjligt. Första ljudet, SP, klipps alltså mitt i P, medan PRÅK klipps mitt i P och mitt i K …

Unit selection är den vanligaste typen av talsyntes i dag; den fungerar oftast perfekt vid uppläsning av trafikmeddelanden och liknande. Men metoden har sina begränsningar när det gäller mer avancerade texter, enligt Joakim Gustafson, professor i talteknologi vid Kungliga tekniska högskolan, KTH, i Stockholm.

– Unit selection kan låta superbra fram till de ställen där språkljuden klipps ihop. Där kan det låta jättedåligt, och det upplevs som irriterande. Det har visat sig att folk ofta hellre vill ha halvbra ljud hela tiden, än bra ibland och dåligt ibland.

Ett annat problem är att betoningen lätt blir fel när man klipper ihop orden. I meningen Jag ser en bil, kan ju orden betonas på olika sätt, och därmed få olika innebörd: JAG ser en bil (till skillnad från dig), Jag SER en bil (jag hör den inte), Jag ser EN bil (inte två) eller Jag ser en BIL (inte en mc). Och vissa ord är homografer, det vill säga ord som skrivs likadant, men uttalas olika: Ser du tomten på tomten? Vem har format detta format? Det är en banan på banan.

Dessutom kan rösterna låta för glada eller för ledsna för sammanhanget. Och ord låter för det mesta olika beroende på var de finns i en mening: i början, i mitten eller i slutet. Ofta går tonhöjden ner i slutet. När vi testade ordet ”Språktidningen” hämtades ordet ”begravNINGEN” i slutet av en mening, där tonhöjden gick ner.

– En felaktig betoning saboterar helhetsupplevelsen. Det skär sig, konstaterar Joakim Gustafson.

När den amerikanske filmkritikern Roger Ebert förlorade rösten i början av 2000-talet, i samband med en canceroperation, fick han en röstprotes med talsyntes skapad genom unit selection. Talsyntesen kunde dessutom göras utifrån hans egen röst från inspelade kommentarer till dvd-utgåvor av klassiska filmer, som Casablanca och Citizen Kane.

– Men det lät inte som om rösten menade vad Roger Ebert menade, berättar Joakim Gustafson. Roger Ebert gick tillbaka till att skriva på lappar, för även om systemet var byggt av hans egen röst, så var det inte han. Han ville ju kunna styra hur han sa saker.

Roger Ebert föreslog då ett ”Ebert-test” av talsyntesen: om den kunde dra ett skämt med rätt timing – då skulle han vara nöjd. Men dit är det fortfarande långt.

– I en dialog förmedlar vi ju så mycket mer med rösten än bara orden, säger Joakim Gustafson. Vi vill kunna dra på orden, låta osäkra, signalera att vi ändrar oss, med mera. Vi vill få en talsyntes som vi kan styra dynamiskt, som utvecklas vartefter.

Dessutom tror han att behovet av bra talsyntes kommer att öka – inte minst i takt med att vi delar miljö med så kallade sociala robotar, till exempel inom industrin och sjukvården.

Det senaste inom talsyntes är att träna datorn på hur en mänsklig röst låter utifrån kortare inspelningar, och därefter kasta bort de inspelade ljuden. Kvar finns då en helt datoriserad röst som kan styras med olika parametrar, till exempel för att göra den ljusare eller mörkare.

Med denna teknik, kallad HMM, hidden Markov model, har Acapela skapat en röstprotes åt den amerikanske ALS-patienten Eric Von Schaumburg, 32 år. Hans egen röst hade redan blivit för dålig för att man skulle kunna spela in den som grund till syntesen, men brodern hoppade in i hans ställe och läste in manustexten. Och Acapela la på en djupare klang för att rösten skulle låta mer som Erics.

Men fortfarande är det svårt att få talsyntesen att låta som en riktig människa.

– I naturligt tal gör vi mycket för att spara röstansträngningen. När du ska säga en bil, så låter det egentligen som ”embil”, eftersom det är lättare att säga. Och vi ger ofta återkoppling för att visa att vi lyssnar, med småord som ah, mm, hm, okej, ja, oj, aha. Men de kan betyda lite olika saker. Ett okej kan ju till exempel vara tvekande eller ironiskt, säger Joakim Gustafson.

För att få det syntetiska talet att låta naturligare, bygger han och hans kolleger upp en databas med dialoger, och gör markeringar i ljudfilerna: ”här låter hon osäker”, ”här vill han inte fortsätta prata” och så vidare, för att lära HMM-syntesen hur vi gör när vi talar med varandra.

– Vi kan, bland annat med hjälp av satsmelodin, visa att vi ändrar oss medan vi pratar. Det var en grö… jag menar BLÅgrön bil. Man höjer grundtonen när man betonar det nya ordet – en ökad intensitet. Och om man är osäker så förlänger man ordet. Den typen av saker finns inte alls i talsyntes i dag.

Ett annat problem i dag är att datorn måste ”lyssna färdigt” innan den kan omvandla text till tal. I Joakim Gustafsons forskning ingår även stegvis dialogbearbetning, för att lära datorn hur meningen sannolikt kommer att fortsätta.

– Behöver datorn känna till nästa ord, och nästnästa? Jag vill ju att den ska börja prata innan jag har skrivit färdigt.

hur läraktig hmm-syntesen än är, så vet den ingenting om hur mänsklig talproduktion faktiskt går till. Vill man ha någon som låter glad måste man spela in det. Det svåra är att fånga in alla styrparametrar som behövs för att skapa nyanserna i talet. Det vore bättre om man kunde förstå hur människor gör när de talar, och sedan bygga en modell av rösten.

Just detta arbetar Sten Ternström med i EU-projektet Eunison. Han är professor i musikakustik vid KTH.

– Om jag gör så här, säger han och knäpper med fingret på sin hals, så kommer det ut en ton, men om jag formar munnen annorlunda så blir det ljudet annorlunda: ”Aaaååoouuiii”.

Våra språkljud som lämnar munnen är egentligen tryckvågor i luften. Lungorna står för luften, magens muskler för kraften. Tonen skapas av svängningar i stämbanden. Själva klangen, den personliga rösten, formas av håligheterna på vägen ut genom munnen. Men många detaljer hos mekanismerna bakom röstens alla nyanser är fortfarande oklara, och de har oftast studerats var för sig.

I det omfattande Eunison-projektet, som koordineras vid KTH, bygger talforskare, fysiker och tekniker från hela Europa en 3D-modell av hela talapparaten – med luftstrupe, stämband, gom, käke, tunga och läppar – för att till fullo försöka förstå hur rösten fungerar. Och hur den fallerar.

– Har man en modell av röstens mekanik, så kan man simulera fram precis hur det ser ut härinne, säger Sten Ternström och pekar på strupen. Om jag säger A är tungan långt bak, med stor käköppning och mycket plats i gommen. Om jag säger I är tungan långt fram. Det blir trångt i käköppningen och mer öppet bak.

Genom att dela in kroppens mjuka och hårda delar i små element modelleras fysiken fram i datorn. Bara stämbanden behöver tusentals element, och forskarna beräknar kraft, massa och fjädring med mera på vartenda ett. Det krävs oerhört stor datorkraft. Även en mekanisk modell med stämband i silikon tas fram.

– Vår färdiga modell över människorösten kommer att likna en marionettdocka. Vi kan rycka i en eller flera trådar och se vad som händer, säger Sten Ternström. Hur rör sig en sladdrig slemhinna när man blåser ut ett ljud från magen, till exempel ett F, ”eeefff”? Och hur studsar ljudet i munhålan?

Ett av stegen är att studera hur tungan flyttas för att framställa olika ljud.

– Om du tänker efter vad du gör med tunga och läppar när du talar, så är det en mirakulös följd av mekaniska händelser.

Med en komplett modell av talapparaten, i kombination med HMM-modellen, som lär sig röstens naturliga prosodi – det vill säga talets rytm och melodi – borde det gå att få fram en riktigt bra talsyntes.

Återstår att se om vi någonsin kommer att kunna skratta åt en skämtande talsyntes.

Eva Barkeman är vetenskapsjournalist.

3 x olika talsynteser

Det finns tre typer av talsyntes:

- Parametrisk syntes, där ljudet skapas genom olika styrparametrar. Ett exempel är formantsyntes, där tal skapas genom att ljud filtreras digitalt genom ett antal uttalsregler, från en artificiell röstkälla. Ett annat exempel är HMM-syntes.

- Konkateneringssyntes, där ljudet klipps ihop av tal från inspelade mänskliga röster, till exempel difonsyntes och unit selection. ”Burkat tal” är ett slags pseudosyntes av förinspelade meningar med luckor som fylls i. Används till exempel i talsvarstjänster och stationsuppläsning.

- Artikulatorisk syntes, där man utgår från en modell av det mänskliga talorganet.

Tidslinje

1780 Tal med gummmitratt

Ungraren Wolfgang von Kempelen gjorde världens första ”talande maskin”, där lungorna simulerades med en blåsbälg, stämbanden med ett rörblad av elfenben och munnen med en gummitratt. Genom att i större eller mindre grad täcka över gummitratten med handen, kunde han skapa olika vokaler och vissa konsonanter. (artikulatorisk syntes)

1950 Formantsyntes

Helt datoriserad. En artificiell ljudkälla skapar en grundton eller ett brus, som filtreras för att efterlikna en mänsklig röst genom att man ställer in olika resonansfrekvenser eller formanter. Vokalerna blir bra, konsonanterna sämre. Låter robotartat. Gunnar Fants modell OVE (se faktarutan här intill) är ett exempel på detta. (parametrisk syntes)

1980 Difonsyntes

Består av en liten mängd inspelade nonsensord. Fonemen (språkljuden) klipps ihop till difoner (två halva fonem), för att forma alla ord i språket. Onaturligt, konstigt uttal. (konkateneringssyntes)

1990 Unit selection

Består av en stor mängd inspelat tal, där olika språkljud markeras så att datorn vet var den ska klippa ihop dem. Vanligast i dag. Ju längre sekvenser, desto mer naturligt. (konkateneringssyntes)

2010 HMM-syntes

Helt datoriserad, men bygger på inlärning från inspelat tal. Rösten kan förändras genom signalbehandling. Genom att träna systemet mot 250 korta exempelmeningar kan en begriplig röst skapas. Detta tar cirka två timmar på en modern dator. Låter ganska naturligt, men lite burkigare än unit selection (konkateneringsyntes + parametrisk syntes).

2020? Fysisk simulering

En fullständig modell av ett mänskligt talorgan med strupe, tunga, tänder och läppar och så vidare. Eunison är ett exempel på denna metod. Genom att simulera hur en luftström passerar stämbanden och studsar i hålrummen beräknas det resulterande ljudet. Metoden är komplex, men talet låter naturligt. Kan kombineras med datorinlärda ljud (artikulatorisk syntes).

Läs med öronen!

Över 120 svenska dagstidningar finns som taltidning*. Sedan förra året läses de upp med talsyntes i stället för av riktiga människor. Teknikskiftet innebär mer innehåll och lättare navigation.

Taltidningar har funnits sedan 1980-talet. Till att börja med producerades de med mänsklig inläsning och sändes ut via radionätet. Men bara ett urval av tidningens innehåll lästes in, kanske en femtedel, på grund av den höga produktionskostnaden.

– Det är ur demokratisynpunkt ett viktigt uppdrag att se till att dagstidningar blir tillgängliga även för personer med läsnedsättning, säger Jesper Klein, avdelningschef vid Medier och tjänster på Myndigheten för tillgängliga medier (MTM).

De flesta som tar del av taltidningar är synskadade, men även personer med till exempel dyslexi har nytta av dem.

De taltidningar som i dag produceras med talsyntes innehåller allt som finns i den tryckta tidningen. De taltidningar som MTM ger ut, läses upp av datorrösten ”Erik” med hjälp av unit selection (läs mer om tekniken i artikeln intill). Tidningarna går att lyssna på i app, dator eller i särskilda spelare.

Fördelen med ”syntetiska” taltidningar är att läsaren själv kan bläddra sig fram till de artiklar som hen vill läsa. Nackdelen är att det kan vara jobbigare att lyssna på en syntetisk röst, särskilt när man är ovan.

– Många användare är positiva. De tycker att det är en frihet att kunna läsa var de vill och vad de vill. Andra tycker att det har varit svårt att ta till sig en ny lösning, säger Jesper Klein.

* Taltidningar är vanliga dagstidningar som görs tillgängliga via talsyntes. Det finns även läns-taltidningar som produceras av radiojournalister för synskadade. Dessa ges ut av Sveriges kommuner och landsting och använder inte talsyntes.

Eva Barkeman